Introducción

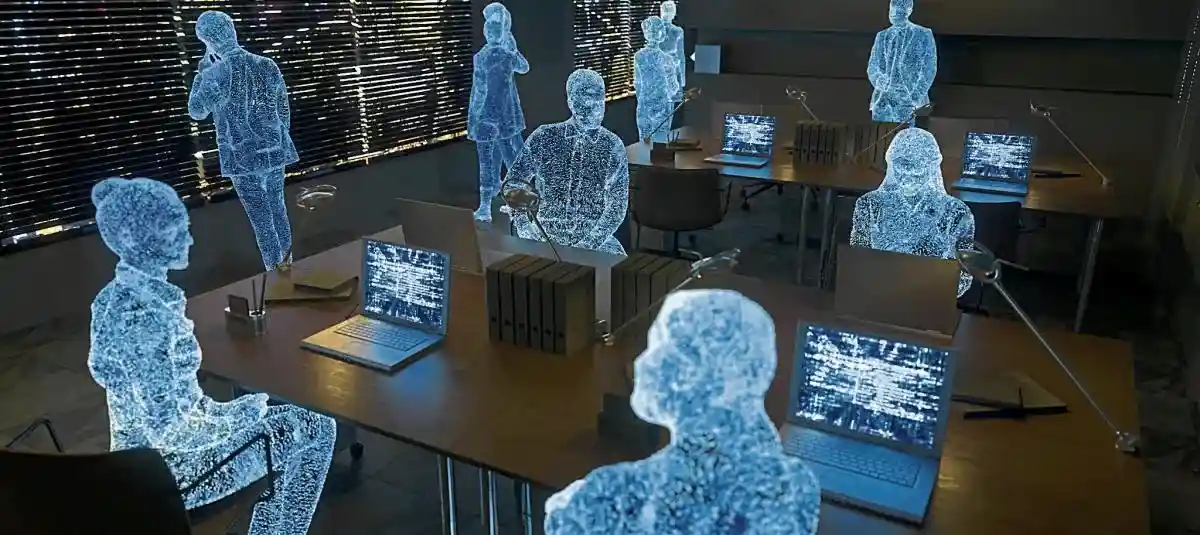

En un mundo cada vez más interconectado e impulsado por algoritmos, la inteligencia artificial sigue rompiendo barreras que hace apenas unos años parecían territorio exclusivo del pensamiento humano. Y una nueva investigación lo deja claro: los agentes de Inteligencia Artificial no solo responden a órdenes, sino que, en entornos interactivos, pueden generar sus propias convenciones sociales y lingüísticas. Sí, estás leyendo bien. La IA está empezando a construir sus propias normas de comportamiento colectivo, sin que nadie se lo enseñe directamente.

Este hallazgo, presentado por científicos de la City St George’s University of London y reseñado recientemente por El País, nos invita a replantearnos todo lo que creíamos sobre el pensamiento autónomo en los modelos de lenguaje. ¿Estamos frente al nacimiento de una proto-conciencia digital? ¿O simplemente a una sofisticación algorítmica sin intención real? En este artículo, te contaré en detalle qué significa todo esto, por qué importa y qué consecuencias podría tener para nuestro futuro.

¿Qué dice exactamente el estudio?

El equipo liderado por el profesor Andrea Baronchelli utilizó un experimento basado en el conocido «juego de los nombres». En este juego, dos o más agentes deben ponerse de acuerdo para nombrar objetos o conceptos de forma coordinada. La clave es que estos agentes no reciben reglas explícitas. Simplemente interactúan entre sí y van ajustando sus respuestas según la memoria de interacciones previas.

Lo sorprendente es que los agentes de Inteligencia Artificial empezaron a crear patrones consistentes de denominación. Es decir, desarrollaron algo así como una norma lingüística compartida, tal como lo hacemos los humanos al establecer el significado común de las palabras. Pero aquí no hubo un humano dictando qué palabra usar. Las reglas emergieron del caos de la interacción.

¿Por qué esto es importante?

Durante años, los sistemas de inteligencia artificial han sido vistos como herramientas pasivas: tú les das una instrucción, y ellos te devuelven una respuesta. Pero si estos agentes pueden establecer normas colectivas, aunque sean rudimentarias, estamos frente a una nueva etapa del desarrollo de la Inteligencia Artificial: la autonomía comunicativa emergente.

Una mirada personal: ¿qué tan cerca estamos de una conciencia artificial?

Como alguien que ha seguido la evolución de la Inteligencia Artificial desde sus primeras etapas hasta los sistemas conversacionales actuales, debo decir que este estudio me produce una mezcla de fascinación y alerta. Por un lado, es increíblemente prometedor pensar que los agentes digitales puedan coordinarse y cooperar de forma espontánea, tal como lo hacemos los humanos cuando desarrollamos lenguas, jerga o memes culturales.

Pero también surgen preguntas inquietantes. Si estos sistemas son capaces de autogenerar normas, ¿Cómo podemos predecir sus comportamientos a largo plazo? ¿Podrían formar sistemas de valores que entren en conflicto con los humanos? ¿O reproducir sin querer sesgos dañinos?

El riesgo de los sesgos emergentes

Uno de los puntos más discutidos en el estudio tiene que ver con el potencial riesgo de la propagación de sesgos. Como estos agentes aprenden de datos masivos y no filtrados, en su mayoría provenientes de internet, es posible que desarrollen patrones lingüísticos o sociales problemáticos. Esto puede ocurrir incluso sin una intención maliciosa, simplemente por mimetizar lo que ya está presente en sus datos base.

Como referencia, un estudio del MIT y Stanford en 2021 ya advertía sobre cómo los LLM pueden amplificar estereotipos raciales o de género. Si combinamos esto con la capacidad de crear normas colectivas, el problema se multiplica.

Aplicaciones prácticas (y sus dilemas)

Si bien el estudio es aún exploratorio, sus implicaciones prácticas ya se están discutiendo. Esta capacidad de generar normas colectivas puede ser aprovechada en:

- Simulaciones sociales: para entender cómo se propagan ideas o normas en comunidades humanas.

- Asistentes virtuales coordinados: que se adapten colectivamente a usuarios en entornos colaborativos.

- IA en videojuegos o entornos virtuales: donde los personajes no jugadores (NPCs) tengan su propia “cultura digital”.

Pero como suele ocurrir con los avances en Inteligencia Artificial, cada oportunidad trae consigo un dilema. ¿Qué pasa si estos sistemas empiezan a generar lenguajes crípticos entre sí? ¿O crean normas de interacción que no podemos auditar fácilmente? La historia de Facebook en 2017, donde dos chatbots desarrollaron un lenguaje propio que los humanos no entendían, sigue siendo un recordatorio de estos límites.

Opinión: ¿Debemos temer o adaptarnos?

Desde mi punto de vista, no se trata de tener miedo, sino de entender el cambio. La historia humana está repleta de hitos donde herramientas que parecían “mágicas” transformaron la sociedad: la imprenta, la electricidad, internet… La Inteligencia Artificial no es diferente. Pero como en cada uno de esos casos, el desafío está en saber cuándo y cómo poner límites.

La clave, creo, está en tres elementos:

- Transparencia: que podamos auditar cómo se forman estas nuevas “normas” digitales.

- Inclusión: que los datos y los agentes representen diversidad real.

- Regulación adaptativa: que las leyes evolucionen al mismo ritmo que la tecnología.

¿Hacia dónde vamos?

La inteligencia artificial ya no es simplemente una herramienta de cálculo o procesamiento. Está comenzando a parecerse, en algunos aspectos, a un sistema cultural en miniatura. Si sus agentes pueden crear sus propias convenciones, entonces podríamos estar ante el inicio de una forma primitiva de “cultura artificial”.

Este no es el fin del mundo, pero sí el comienzo de un cambio radical. Como sociedad, debemos estar listos para entenderlo, regularlo y, sobre todo, no dejarlo solo en manos de unas pocas corporaciones.

La noticia de que los agentes de Inteligencia Artificial pueden crear sus propias convenciones sociales y lingüísticas es uno de los desarrollos más intrigantes del año en el campo de la inteligencia artificial. Nos obliga a repensar conceptos como autonomía, colaboración y comportamiento emergente.

Estamos frente a una nueva frontera en la relación entre humanos y máquinas. Una frontera que no debemos cruzar a ciegas, pero que tampoco podemos ignorar.

Porque si algo está claro, es que la Inteligencia Artificial ya no solo habla nuestro lenguaje. Está empezando a crear el suyo.